Apple начнет сканировать локальные медиатеки владельцев iPhone с целью выявления детской порнографии

Apple готовится к запуску функции neuralMatch, предназначенной для локального сканирования пользовательских фотоснимков, хранящихся на iPhone без загрузки копий в облачное хранилище. В случае обнаружения незаконных фотоснимков система будет ставить об этом в известность сотрудников корпорации.

Для обучения нейросети neuralMatch специалисты Apple использовали 200 тыс. изображений. Во время сканирования хранящиеся в памяти iPhone снимки будут сравниваться с образцами из базы данных.

Каждой загружаемой в iCloud фотографии будет присваиваться метка. По ней можно будет определить, является ли снимок подозрительным или нет. Подозрительные снимки будут расшифровываться корпорацией и передаваться в компетентные органы.

Фотоснимка в iCloud уже сканируются Apple с целью выявления случаев насилия над детьми. Корпорация сообщила об этом в начале минувшего года. Какая именно технология для этого используется, неизвестно. Компании Google, Twitter и Facebook используют для проверки фотоснимков систему PhotoDNA.

В отношении GeekBrains подан второй по счету коллективный иск за отказ вернуть деньги за курсы

Meta Playforms решила приостановить набор персонала из-за медленного роста

VK ведет переговоры о поглощении сервисов бронирования жилья

Wargaming успела продать российский бизнес до введения запрета

Honor свернул поставки смартфонов на российский рынок

Собственник Avito не хочет продавать классифайд VK

Работа «белых хакеров» в России будет легализована

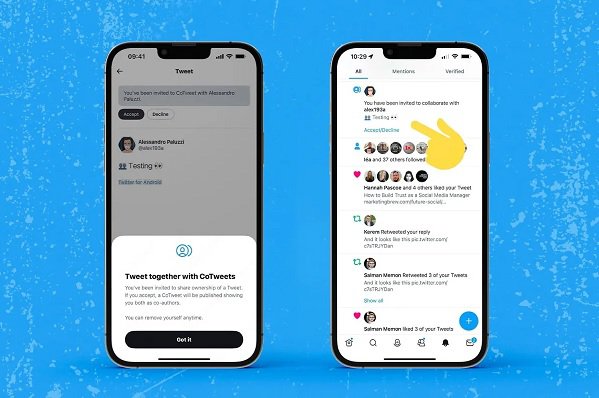

Twitter тестирует функцию совместного постинга

Pinterest и Twitch наказали за отказ от локализации данных